-

📧 TheLab Weekly Digest

Άρθρα, reviews και ό,τι κινήθηκε στο forum. Κάθε Κυριακή.

- 📰 Τα άρθρα που ξεχώρισαν

- 🧪 Reviews από τον πάγκο δοκιμών

- 💬 Τι κινήθηκε στο forum

All Activity

This stream auto-updates

- Τελευταία ώρα

-

Ο πρώτος υπολογιστής που με εντυπωσίασε

Oric απάντησε στο θέμα του sotiris topic στην ενότητα Φορητοί υπολογιστές

Από το παρελθόν έρχεται, μην πετάξεις τα λεφτά σου. Δηλαδή, συγγνώμη τώρα, ζητάνε τέσσερα χιλιάρικα επειδή έβαλαν σ' αυτό το κολοκύθι δυό οθόνες, τη μια μπροστά 'π' την άλλη, μαζί με 32 ψωρογιγαμπάιτ μνήμη; Το μέλλον είναι επεξεργαστές RISC. RTX Spark με unified memory, Snapdragon X2 Elite και Elite Xtreme. Τα Windows είναι έτοιμα και κάτι μου λέει πως είναι έτοιμο και το Office, αν δηλαδή χρειάζεται αλλαγές για τον Spark. Τα υπόλοιπα θα ακολουθήσουν, και εν τω μεταξύ θα παίζουν με ενδιάμεσο layer (που δεν πιστεύω να είναι τόσο αποτελεσματικό όσο η Rosetta της Apple, αλλά με τον καιρό θα στρώσει). Το Linux υποθέτω πως θα είναι έτοιμο για τις γιορτές, ενώ ήδη τρέχει στους Snapdragon παραγωγής. H Apple είναι RISC, το Android είναι RISC, η ΙΒΜ είναι RISC, η Tesla τρέχει το FSD σε δικούς της επεξεργαστές RISC, η Intel κατήργησε αθόρυβα το hyperthreading ελευθερώνοντας χώρο μέσα στο chip, η AMD άλλα λόγια ν' αγαπιόμαστε. Οι gamers θα ανακαλύψουν τους RISC επεξεργαστές όταν βγει η ανάλογη έκδοση της Unreal Engine. RISC. Τελεία. -

Προσπερνάω το μπουγαδόζουμο Black Coffee καθώς και το Common Sense διότι σαν έννοια δεν υφίσταται . Αυτό το Second Amendment (δηλαδή : Right to Bear Arms) τι το ήθελες ; Δεν ήξερες πως εδώ, ακόμα και το κουταλοπίρουνο θεωρείται οπλοκατοχή ;

-

- 27.377 απαντήσεις

-

- funny pictures

- memes

-

(και 5 επιπλέον)

Tagged with:

- Σήμερα

-

.thumb.jpg.9a921205b9aa72bdfad8ea52635b9d2c.jpg)

Ο πρώτος υπολογιστής που με εντυπωσίασε

sotiris απάντησε στο θέμα του sotiris topic στην ενότητα Φορητοί υπολογιστές

exactly. get ready Για τους πιο νέους, θα βγει κι αυτό: Αλλά εγώ θέλω το άλλο που είναι μικρό και μετά σε portrait βλέπεις καλά pdf etc. -

Ο πρώτος υπολογιστής που με εντυπωσίασε

trib απάντησε στο θέμα του sotiris topic στην ενότητα Φορητοί υπολογιστές

Το είχε δείξει ο Linus στο show του Fallon -

.thumb.jpg.14a3df6f5853e0ce92219404fd5d940d.jpg)

Ο πρώτος υπολογιστής που με εντυπωσίασε

Cyber_Cookie απάντησε στο θέμα του sotiris topic στην ενότητα Φορητοί υπολογιστές

-

Αμην! Ε τι το λες και δεν το κανεις??? Μετα τους χαλαγε το θεμα του assetto γιατι ειχε πολυ κινηση.

-

- 27.377 απαντήσεις

-

- funny pictures

- memes

-

(και 5 επιπλέον)

Tagged with:

-

Η TSMC εισέρχεται σε μαζική παραγωγή N2 (2nm) στο δεύτερο μισό του 2025, με τον ρυθμό αποκατάστασης ελαττωμάτων να ξεπερνά ήδη εκείνον του N3, σύμφωνα με τα στοιχεία του Tech Symposium 2026.Η χωρητικότητα CoWoS αναμένεται να αυξηθεί πάνω από 80% μεταξύ 2022–2026, ενώ το SoIC με ρυθμό ετήσιας ανόδου άνω του 100% — εκτίμηση Liberty Times βάσει στοιχείων TSMC.Έως το 2029, τα πακέτα CoWoS θα φτάνουν σε μέγεθος άνω των 14 reticle με 24 στοίβες HBM5E, ενώ το σύστημα SoW-X θα ενσωματώνει 64 στοίβες HBM — στόχοι που ανακοινώθηκαν επίσημα στο North American Technology Symposium 2026. Η TSMC, η μεγαλύτερη μεταλλουργία (foundry) ημιαγωγών στον κόσμο, παρουσίασε τον αναλυτικό χάρτη πορείας επέκτασής της σε πολλαπλά μέτωπα: νέοι κόμβοι λιθογραφίας, προηγμένες τεχνολογίες συσκευασίας και γεωγραφική διασπορά παραγωγής. Τα δεδομένα προέρχονται τόσο από το Taiwan Technology Symposium του Μαΐου 2025 όσο και από το North American Technology Symposium του Απριλίου 2026. N2: Πρώτος κόμβος NanoFlex σε μαζική παραγωγή Το N2 εισέρχεται σε μαζική παραγωγή στο δεύτερο μισό του 2025, με κύρια εργοστάσια παραγωγής το Fab 20 στο Hsinchu και το Fab 22 στο Kaohsiung — και τα δύο εγκαινιάστηκαν το 2022. Σύμφωνα με στοιχεία του TSMC Tech Symposium 2026, το N2 επιτυγχάνει ταχύτερη μείωση πυκνότητας ελαττωμάτων σε σχέση με το N3 — αξιοσημείωτο γεγονός, καθώς το N3 ήταν ο τελευταίος κόμβος FinFET και το N2 είναι ο πρώτος κόμβος NanoFlex. Η υιοθέτηση του N2 από πελάτες AI ήδη από την πρώτη του χρονιά είναι διπλάσια σε σχέση με αυτήν του N5 κατά την αντίστοιχη φάση. Η TrendForce εκτιμά ότι η μηνιαία χωρητικότητα παραγωγής 2nm θα μπορούσε να φτάσει τις 40.000 πλακέτες (wafers) στα τέλη του 2025, να επεκταθεί κατά επιπλέον 50% στα μέσα του 2026 και να διπλασιαστεί στις 80.000–90.000 πλακέτες έως το τέλος του 2026. Παράλληλα, η χωρητικότητα N3 αναμένεται να αυξηθεί κατά 60% μέσα στο 2025, με παραλλαγές N3E, N3P και N3X που καλύπτουν ανάγκες από HPC έως automotive. Το Fab 25 στο Taichung αναμένεται να ξεκινήσει κατασκευή στα τέλη του 2025 και να παράγει chips με τεχνολογία πιο προηγμένη από 2nm έως το 2028. CoWoS: Από 5,5 reticle σήμερα σε πάνω από 14 reticle το 2029 Το CoWoS (Chip-on-Wafer-on-Substrate) αποτελεί τον κορμό της προηγμένης συσκευασίας της TSMC για επιταχυντές AI, και το πρόγραμμα κυκλοφορίας του καλύπτει ήδη ολόκληρη την υπόλοιπη δεκαετία. Το 2026, η TSMC παράγει ήδη το μεγαλύτερο CoWoS του κόσμου σε μέγεθος 5,5 reticle, με απόδοση άνω του 98%. Οι προηγούμενοι χάρτες πορείας CoWoS κορυφώνονταν στα 9,5 reticle. Πλέον η εταιρεία σχεδιάζει πακέτα System-in-Package (SiP) 14 reticle και άνω, με έως 24 στοίβες HBM5E, έως το 2029. Αυτό το επίπεδο ενσωμάτωσης σχεδιάστηκε για να καλύψει την αχόρταγη ζήτηση των επιταχυντών AI για υπολογιστική ισχύ και εύρος ζώνης μνήμης, αναδεικνύοντας τη συσκευασία — και όχι πλέον μόνο τη λιθογραφία — ως κύριο μοχλό εξέλιξης των ημιαγωγών. Σύμφωνα με Liberty Times, η χωρητικότητα CoWoS της TSMC αναμένεται να αυξηθεί κατά πάνω από 80% στη διάρκεια 2022–2026. Στο χάρτη πορείας, το CoWoS-L με μέγεθος 5,5x κυκλοφορεί το 2026, ενώ η έκδοση με ρεκόρ μεγέθους 9,5x, που ενσωματώνει 12 ή περισσότερες στοίβες HBM, είναι προγραμματισμένη για το 2027. SoIC και SoW-X: Η τρισδιάστατη στοίβαξη πάει επόμενο επίπεδο Το SoIC (System on Integrated Chips) αποτελεί την τεχνολογία τρισδιάστατης στοίβαξης πυριτίου (3D silicon stacking) της TSMC, όπου πολλαπλά chiplets (τμηματοποιημένα τσιπ) ενοποιούνται σε ενιαία δομή με εξαιρετικά στενές αποστάσεις επαφής. Το SoIC εισέρχεται σε μαζική παραγωγή το 2025 για διαμορφώσεις N3-on-N4. Η χωρητικότητα SoIC αναμένεται να αναπτυχθεί με σύνθετο ετήσιο ρυθμό άνω του 100% μεταξύ 2022 και 2026, σύμφωνα με Liberty Times. Σε αριθμούς, η χωρητικότητα SoIC ανερχόταν σε 4.000 πλακέτες ανά μήνα το 2024 και αναμένεται να διπλασιαστεί στις 8.000 το 2025. Στην κορυφή της ιεραρχίας βρίσκεται το SoW-X (System-on-Wafer-X). Το SoW-X προσφέρει βελτίωση επιδόσεων 40x σε σχέση με το CoWoS, αναπαράγοντας τις δυνατότητες ολόκληρου server rack, και είναι προγραμματισμένο για μαζική παραγωγή το 2027. Ο χάρτης πορείας CoWoS και SoW εκτείνεται έως το 2029, με το SoW-X να προβλέπεται να χωράει 64 στοίβες HBM. Γεωγραφική επέκταση: 18 νέες εγκαταστάσεις παγκοσμίως Στις 14 Μαΐου 2026, η TSMC ανακοίνωσε ότι επεκτείνει ταχύτατα την παραγωγική της ικανότητα σε CoWoS και SoIC, με την κατασκευή 18 νέων εργοστασίων και εγκαταστάσεων προηγμένης συσκευασίας παγκοσμίως, λόγω της ζήτησης από AI. Το 2025 μόνο, η TSMC ανακοίνωσε κατασκευή 9 νέων εγκαταστάσεων — 8 εργοστάσια wafer και 1 εγκατάσταση προηγμένης συσκευασίας — με 11 εργοστάσια ήδη υπό κατασκευή στην Ταϊβάν, σε Hsinchu, Tainan, Taichung και Kaohsiung. Στο Kaohsiung σχεδιάζεται η ανέγερση πέντε εργοστασίων που θα υποστηρίζουν 2nm, A16 και μελλοντικούς κορυφαίους κόμβους. Διεθνώς, τα εργοστάσια στην Αριζόνα και στο Kumamoto της Ιαπωνίας είναι ήδη σε λειτουργία, ενώ η NVIDIA αποκάλυψε τον Απρίλιο ότι τα Blackwell AI GPU κυκλοφορούν ήδη από το εργοστάσιο της TSMC στο Phoenix. Για την προηγμένη συσκευασία στις ΗΠΑ, η TSMC σχεδιάζει να ξεκινήσει κατασκευή δύο εγκαταστάσεων SoIC και CoPoS στις ΗΠΑ το 2028, δίπλα στο τρίτο εργοστάσιο της Αριζόνας (F21 P3), το οποίο θα διαθέτει τεχνολογία N2 και A16. Το SoIC θα αναπτυχθεί πρώτο, καθώς βρίσκεται ήδη σε μαζική παραγωγή για λογαριασμό της AMD, με αναμενόμενη υιοθέτηση από Apple, NVIDIA και Broadcom για κορυφαία προϊόντα επόμενης γενιάς. Κεφαλαιουχικές δαπάνες: Έως 50 δισ. δολάρια το 2026 Σύμφωνα με Commercial Times, οι θεσμικοί επενδυτές αναμένουν οι κεφαλαιουχικές δαπάνες (CapEx) της TSMC για το 2026 να φτάσουν τα 50 δισεκατομμύρια δολάρια, ενισχυμένες από τη ζήτηση AI, ενώ για το 2025 η εκτίμηση ανέρχεται στα 40–42 δισεκατομμύρια δολάρια. Στην αλυσίδα εφοδιασμού, τεχνολογίες όπως το SoIC και το WMCM (Wafer-Level Multi-Chip Module) αναμένεται να αποκτήσουν ορμή παράλληλα με το CoWoS, δημιουργώντας παρακλάδια ζήτησης και για υπεργολάβους συσκευασίας (OSAT). Αξίζει να σημειωθεί ότι το A16, που είχε ανακοινωθεί για παραγωγή στα τέλη του 2026, μετατέθηκε για το 2027, σύμφωνα με τα ενημερωμένα δεδομένα του TSMC Tech Symposium 2026. Αντίθετα, η ανακοίνωση του A12 για το 2029 θεωρείται επιθετική επιτάχυνση στην παράδοση νέων τεχνολογικών κόμβων. Πηγές Tom's Hardware — Analyzing TSMC's fab expansion roadmap Semiconductor Engineering — TSMC Tech Symposium 2026, By The Numbers TrendForce — TSMC to Build 9 Facilities in 2025 TrendForce — TSMC's 2026 CapEx Reportedly Near US$50B TrendForce — TSMC U.S. Advanced Packaging Plants in 2028 Tom's Hardware — TSMC's next-gen CoWoS roadmap: over 14-reticle packages by 2029

-

-

Μετά από πάρα πολλά χρόνια. Είμαι παληός στα πισιά (τόσο παληός που γράφεται με "ήτα"), και νόμιζα ότι τα έχω δει όλα. Στη Lenovo στο mall όμως είδα αυτό: https://www.lenovo.com/us/en/p/laptops/thinkbook/thinkbook-plus/thinkbook-plus-gen-6-rollable-14-16-inch-intel/len101b0056 Με το πάτημα ενός κουμπιού, ξετυλίγεται η οθόνη. Είναι ό,τι πιο απίστευτο έχω δει σε φορητό υπολογιστή τα τελευταία ίσως 20 χρόνια. Σαν specs είναι 1 μοντέλο (ρώτησα και το έψαξα κι εγώ), με τις γενιές των intel που προσπαθούν να ανταγωνιστούν τα Μ3/Μ4/Μ5 της Apple σαν λογική αλλά δύσκολο. Είναι λίγο βαρύ (1.7 κιλά) αλλά δεδομένου ότι από 14ρι γίνεται 17ρι portrait δηλαδή mode πρεσβύωπος και μάλιστα με το aspect ratio όπως μας έχουν κακομάθει τα κινητά, θεωρώ ότι έρχεται από το μέλλον! Τιμή 4500 στο themall, ακατέβατη. Ελβετία το έχω βρει 2000 chf από μεγαλοκαταστήματα, οπότε αν καταφέρω και βρω πως μπορώ να δουλέψω την klarna σε 3/4 δόσεις θα είναι το επόμενο gadget. Είχα πει δεν ξανααγοράζω laptop γιατί μου τα χουν κλέψει όλα αυτοί που θάβει η Λατινοπούλου, εκτός από το A6Ja (μου χουν κλέψει συνολικά 5 λάπτοπ, Alienware M11x, Dell Precision 7720, MSI Wind U100, ένα παλιό IBM και ένα με PCMCIA slots και DSTN οθόνη που είχα για το AWMN παλιά), αλλά αυτό μου άρεσε τόσο που ίσως παραβώ τον ιερό κανόνα μου.

-

Όσοι το εγκαταστήσετε και δείτε ότι μας ξεφεύγει κάτι, περνάτε καμιά βόλτα από δω να το σημειώνετε. Του GOG μπορεί να μη σωζόταν έτσι κι αλλιώς, αλλά για Steam/Epic που φαίνεται να ενημερώνει η εφαρμογή μπορεί να βολέψει.

-

Corsair iCUE LINK TITAN 240 RX RGB AIO Liquid CPU Cooler Review

Το μέλος Trexx σχολίασε στην δημοσίευση του Cyber_Cookie στην ενότητα Heatsinks, Coolers & Watercooling Reviews

Πλέον στα 50 ευρώ από plaisio και eshop. Είμαι σε δίλημμα. -

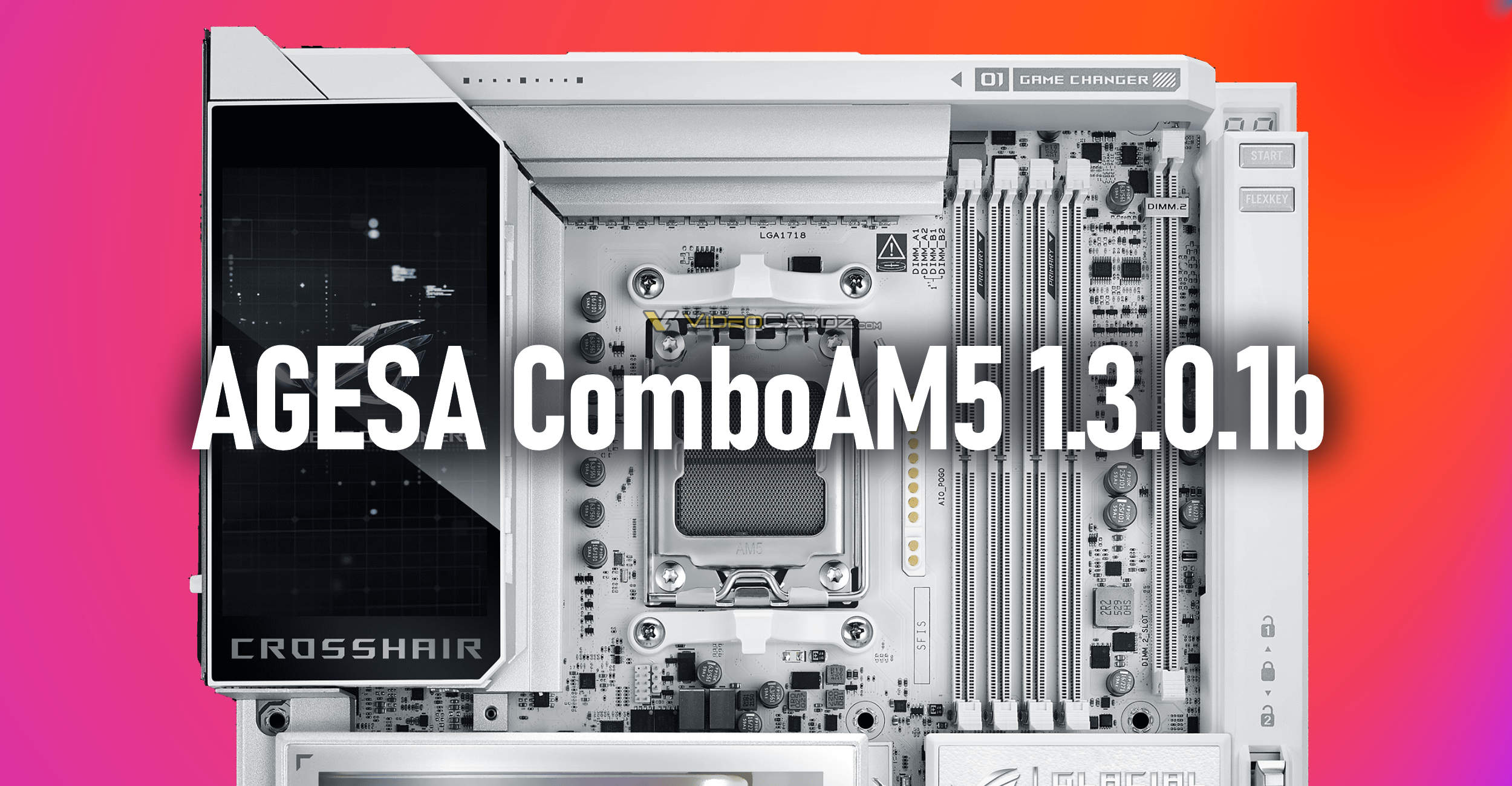

Η ASUS κυκλοφόρησε beta BIOS 2301 για τις ROG Crosshair X870E μητρικές, εισάγοντας υποστήριξη AMD EXPO 1.2 με λειτουργία Ultra Low Latency για DDR5 μνήμες.Το EXPO 1.2 συνδέεται με τα νέα CUDIMM modules και προσφέρει πρόσθετα εργαλεία ρύθμισης χρονισμών μνήμης στους enthusiast χρήστες.Η ενημέρωση καλύπτει όλη τη σειρά ROG Crosshair X870E (HERO, DARK HERO, APEX, EXTREME, GLACIAL), ROG Strix, TUF Gaming και ProArt X870E — με σημαντική προειδοποίηση για παλαιά αρχεία CMO. Η ASUS ανακοίνωσε beta BIOS για τη σειρά μητρικών X870 και X870E της AM5 πλατφόρμας, με κεντρικό χαρακτηριστικό την υποστήριξη AMD EXPO 1.2 — της αναβαθμισμένης έκδοσης του προτύπου Extended Profiles for Overclocking για DDR5 μνήμες. Πρόκειται για μία από τις πρώτες υλοποιήσεις του EXPO 1.2 στην αγορά μητρικών πλακετών. Τι περιλαμβάνει το beta BIOS 2301 Η ASUS ανάρτησε νέα beta BIOS αρχεία για αρκετές μητρικές X870 και X870E. Η ενημέρωση φέρει την ονομασία Beta BIOS 2301 για τα περισσότερα μοντέλα, ενώ συγκεκριμένες πλακέτες χρησιμοποιούν τις εκδόσεις 0911 ή 1670. Σύμφωνα με το επίσημο changelog, οι πιο σημαντικές προσθήκες είναι η υποστήριξη AMD EXPO 1.2 για τα προφίλ overclocking RAM και η εισαγωγή της νέας λειτουργίας Crosshair Tweak. Παράλληλα, η εταιρεία προειδοποιεί ότι παλαιά αρχεία CMO δεν πρέπει να χρησιμοποιούνται με αυτό το BIOS που βασίζεται σε AGESA 1301. Η ενημέρωση καλύπτει τα ROG Crosshair X870E HERO, HERO BTF, DARK HERO, APEX, EXTREME και GLACIAL. Περιλαμβάνει επίσης πολλαπλά μοντέλα ROG Strix X870 και X870E, TUF Gaming X870 και την ProArt X870E Creator WiFi. Τι είναι το EXPO 1.2 και γιατί έχει σημασία Το AMD EXPO (Extended Profiles for Overclocking) είναι το ισοδύναμο της AMD απέναντι στο Intel XMP: αποθηκεύει προκαθορισμένα προφίλ συχνότητας, χρονισμών και τάσης απευθείας στη μνήμη, επιτρέποντας εύκολη ενεργοποίηση overclocking από το BIOS. Η έκδοση 1.2 εισάγει νέες λειτουργίες μνήμης βελτιστοποιημένες για χαμηλή καθυστέρηση, συμπεριλαμβανομένης της λειτουργίας ULL (Ultra-Low-Latency) για κιτ EXPO. Αυτό δεν προσφέρει κάτι ουσιαστικό στους περισσότερους gamers ή απλούς enthusiasts, αλλά για τους ειδικούς στη βαθμονόμηση μνήμης παρέχει επιπλέον δυνατότητες ρύθμισης χρονισμών και πιο ικανά overclocks DDR5. Το εργαλείο HWiNFO πρόσθεσε υποστήριξη AMD EXPO 1.20 ήδη από τον Δεκέμβριο, και ο γνωστός ειδικός overclocking 1usmus ανέφερε ότι το EXPO 1.2 συνδέεται με υποστήριξη CUDIMM μνήμης. Τα CUDIMM (Clocked Unbuffered DIMM) αποτελούν νέο τύπο DDR5 module που χρησιμοποιεί ενσωματωμένο ρολόι για την επίτευξη υψηλότερων ταχυτήτων με καλύτερη σταθερότητα σε σχέση με τα συμβατικά UDIMM. Πλαίσιο: AGESA 1.3.0.1 και η εξέλιξη του BIOS στο AM5 Μια προγενέστερη ενημέρωση στον ίδιο κλάδο AGESA 1.3.0.1 είχε ήδη προσθέσει υποστήριξη EXPO 1.2. Στο AGESA 1.3.0.1b η ASUS πρόσθεσε τρεις επιλογές χρονισμού DDR5 στο μενού AMD OC: tCCD_L, tCCDL_WR και tCCDL_WR2 — ελέγχους χαμηλού επιπέδου που απευθύνονται κυρίως σε χρήστες που ρυθμίζουν χειροκίνητα DDR5. Σύμφωνα με ανάρτηση σε φόρουμ ROG, τα X670 και B650 motherboards αναμένεται να λάβουν υποστήριξη EXPO 1.2 στο μέλλον. Η AMD δεν έχει δημοσιεύσει ακόμη πλήρη λίστα με τους κατασκευαστές που υποστηρίζουν το πρότυπο, αλλά η ASUS με αυτή τη βήτα ενημέρωση τοποθετείται μεταξύ των πρώτων που το ενεργοποιούν. Ο 1usmus αναφέρει επίσης ότι η AMD συνεργάζεται με Κινέζους κατασκευαστές DDR5 μνήμης για να επεκτείνει τη γκάμα EXPO, απαντώντας στην τρέχουσα έλλειψη DRAM. Τα ονόματα που αναφέρονται είναι RAMXEED, Rui Xuan (πρώην Rei Zuan) και Fujitsu. Σημαντική προειδοποίηση για χρήστες Οι προγραμματιστές προειδοποιούν ρητά ότι παλαιά αρχεία προφίλ ρυθμίσεων CMO δεν μπορούν να χρησιμοποιηθούν με την τρέχουσα έκδοση firmware που βασίζεται στον μικροκώδικα AGESA 1301. Όσοι έχουν αποθηκευμένα προφίλ overclocking μνήμης θα πρέπει να τα δημιουργήσουν εκ νέου μετά την εγκατάσταση του beta BIOS. Η ενημέρωση διατίθεται ως beta, επομένως δεν συνιστάται σε παραγωγικά συστήματα χωρίς προηγούμενο έλεγχο σταθερότητας. Τα αρχεία beta BIOS είναι διαθέσιμα μέσω του επίσημου φόρουμ ROG της ASUS. Πηγές VideoCardz – ASUS ROG Crosshair X870E beta BIOS adds AMD EXPO Ultra Low Latency support VideoCardz – ASUS rolls out AMD EXPO 1.2 support for X870 beta BIOS TweakTown – AMD launches EXPO 1.2 for CUDIMM and low-latency DDR5 memory VideoCardz – ASUS releases AGESA 1.3.0.1b BIOS for AM5 X870 boards

-

Τρόμος σκιάς ; Η λέξεις "Κούλης" και "Αλέξης", φέρνουν πιο πολύ τρόμο . Αυτά, την καλημέρα μου .

-

Με αφορμή αυτό το "Δεν πρόλαβες" κάποιος έφτιαξε μια δωρεάν εφαρμογή που σου πετάει notifications από Steam και Epic, ποια παιχνίδια είναι δωρεάν - για να τα πάρεις εκείνη τη στιγμή αμέσως. Χωρίς login - μπαίνεις μετά εσύ ο ίδιος στο Steam και Epic και τα κάνεις Claim. Έχει ήδη 10K downloads από 8 Ιουνίου. Μόνο για Android - Steamletter - Apps on Google Play PLAY.GOOGLE.COM Get instant alerts when Steam games go free

-

το ακουσα ολο ...κατι εχω παθει... Καλημερα

-

007 First Light Is the Latest Denuvo Game That Has Been Cracked WWW.DSOGAMING.COM This time, voices38 has cracked the latest version of Denuvo, which was used in the latest James Bond...

-

PREVIEW: Blood Message Deserves Way More Attention Than It's Getting - Insider Gaming INSIDER-GAMING.COM Blood Message is shaping up to be something truly special, and it was easily my favorite game from the...

-

Αντικαλημεράκηδες παραδέχονται ότι αγαπούν στα κρυφά τις καλημέρες μας. Καλημέρα, λούτσοι μου.

-

Ο Hotfix 595.76 διορθώνει bug του οδηγού 595.71 που περιόριζε την τάση (voltage) στις υπερχρονισμένες RTX 50, αποτρέποντάς τες από το να φτάσουν τις αναμενόμενες συχνότητες boost.Επιπλέον διορθώνονται οπτικά artifacts και βελτιώνεται η απόδοση path tracing στο Resident Evil Requiem, καθώς και crashes κατά την εκκίνηση του Star Citizen.Ο οδηγός διανέμεται μέσω του καναλιού NVIDIA Customer Care — δεν έχει πλήρη πιστοποίηση WHQL — και προτείνεται μόνο σε όσους επηρεάστηκαν από τα συγκεκριμένα προβλήματα. Η NVIDIA κυκλοφόρησε στις 4 Μαρτίου 2026 τον GeForce Hotfix Display Driver έκδοσης 595.76, με στόχο να αντιμετωπίσει μια σειρά σοβαρών παλινδρομήσεων που εισήγαγε ο προηγούμενος οδηγός 595.71. Ο νέος οδηγός βασίζεται στον Game Ready Driver 595.71 και στοχεύει ένα περιοριστικό voltage cap που εμφανίστηκε σε υπερχρονισμένες διαμορφώσεις. Το πρόβλημα: voltage cap που «έσπαγε» τον υπερχρονισμό Ο περιορισμός τάσης εμφανίστηκε λίγο μετά την κυκλοφορία του 595.71 στις 3 Μαρτίου — ο οποίος είχε κυκλοφορήσει για να λύσει προβλήματα που είχε εισαγάγει η έκδοση 595.59. Χρήστες με GPU της σειράς RTX 50 «Blackwell» ανέφεραν μειωμένες συχνότητες boost και πτώση επιδόσεων υπό φορτίο, με παρατηρούμενες τιμές τάσης χαμηλότερες από ό,τι στους προηγούμενους οδηγούς. Με τον οδηγό 595.71, οι υπερχρονιστές διαπίστωσαν ότι οι κάρτες τους έγιναν ξαφνικά ασταθείς: οι τάσεις ήταν περιορισμένες, εμποδίζοντας τις GPU να φτάσουν τα αναμενόμενα επίπεδα boost και με αποτέλεσμα μειωμένες επιδόσεις ή/και αστάθεια συστήματος. Σύμφωνα με αναφορές που επικαλείται η VideoCardz, οι χρήστες παρατηρούσαν «ανώτατο όριο γύρω στα 0,95 έως 0,975V και συχνότητες που σταματούσαν περίπου στα 2.955–2.985 MHz, ακόμη και μετά την εφαρμογή χειροκίνητου υπερχρονισμού». Το γεγονός ότι δεν υπήρχε καμία αναφορά στις σημειώσεις έκδοσης του 595.71 για τον εν λόγω περιορισμό υποδήλωνε ότι η NVIDIA δεν ήταν εξαρχής ενήμερη για αυτή τη συμπεριφορά. Με την κυκλοφορία του hotfix 595.76 είναι πλέον προφανές ότι επρόκειτο για bug. Τι διορθώνει ο 595.76 Σύμφωνα με τις σημειώσεις της NVIDIA, το πρόβλημα περιγράφεται ως voltage cap που εμφανίζεται όταν εφαρμόζεται υπερχρονισμός, εμποδίζοντας την κάρτα να φτάσει τα αναμενόμενα επίπεδα — και ο 595.76 σχεδιάστηκε ώστε να αποκαταστήσει την κανονική συμπεριφορά τάσης και boost. Στο Resident Evil Requiem διορθώνεται η εμφάνιση λευκών φωτεινών artifacts όταν ήταν ενεργοποιημένο το Subsurface Scattering, ενώ περιλαμβάνεται και βελτίωση της απόδοσης path tracing. Οι παίκτες του Star Citizen αντιμετώπιζαν crashes κατά την εκκίνηση του παιχνιδιού με τον 595.71 — το νέο hotfix αντιμετωπίζει και αυτό το ζήτημα. Τέλος, αντιμετωπίζεται και το πρόβλημα με οθόνες HDCP 1.x: τυχαία crashes εφαρμογής ή driver timeout κατά την αναπαραγωγή DRM-προστατευμένου περιεχομένου σε browser με παλαιότερες οθόνες HDCP 1.x. Συνοπτικά, τα διορθωμένα ζητήματα: Πρόβλημα Κατάσταση στον 595.76 Voltage cap υπό υπερχρονισμό (RTX 50) Διορθώθηκε Resident Evil Requiem — λευκά artifacts (Subsurface Scattering) Διορθώθηκε Resident Evil Requiem — απόδοση path tracing Βελτιώθηκε Star Citizen — crashes κατά την εκκίνηση Διορθώθηκε HDCP 1.x — crashes/timeout DRM σε browser Διορθώθηκε Hotfix ή αναμονή για WHQL; Ο 595.76 διανέμεται μέσω του καναλιού NVIDIA Customer Care και όχι μέσω της τυπικής ροής δημόσιων οδηγών. Υποβάλλεται σε συντομευμένο κύκλο ελέγχου ποιότητας και συνήθως αποσύρεται μόλις τα fixes του ενσωματωθούν σε μεταγενέστερη έκδοση με πιστοποίηση WHQL. Οι χρήστες που δίνουν προτεραιότητα στη μέγιστη σταθερότητα μπορούν να αναμένουν το επόμενο WHQL πακέτο — αντίθετα, όσοι επλήγησαν άμεσα από το voltage cap, ιδίως αν το προφίλ υπερχρονισμού τους επηρεάζει την κανονική λειτουργία boost, μπορούν να εγκαταστήσουν το hotfix άμεσα. Από αναφορές της κοινότητας, η μειωμένη τάση οδηγούσε σε μετρήσιμη πτώση επιδόσεων — σε ορισμένες περιπτώσεις με διψήφια ποσοστιαία πτώση — κάτι ιδιαίτερα επώδυνο σε κάρτες υψηλών επιδόσεων όπου οι χρήστες βασίζονται στο χειροκίνητο tuning. Σύμφωνα με πρώιμες δοκιμές της κοινότητας, η συμπεριφορά τάσης φαίνεται να έχει διορθωθεί στα επηρεαζόμενα RTX 50 συστήματα. Πηγές Guru3D — GeForce Hotfix Driver 595.76 download Guru3D — GeForce 595.76 Hotfix driver download (πλήρεις σημειώσεις) VideoCardz — NVIDIA releases 595.76 hotfix driver TechPowerUp — NVIDIA Releases GeForce 595.76 Hotfix Driver TechRadar — Nvidia's GPU driver 'totally wrecked' user overclocks Overclock3D — Nvidia fixes overclock and game issues with GeForce Hotfix 595.76

-

Ειδήσεις απο την Ελλάδα και όλο τον κόσμο v2.0

DEADLAZARUS απάντησε στο θέμα του astrolabos topic στην ενότητα Off topic

O μύθος για το Κάλλιο που εμφανίζεται όταν δεν έχουμε νερό WWW.NEWS247.GR Οι φετινές βροχές μάς κάνουν να πιστεύουμε πως φέτος δεν θα έχουμε πρόβλημα με το νερό στην Αττική... - Χθες

-

Τα πάντα για το Steam (Πληροφορίες, Νέα, Προσφορές, Προβλήματα)

acct απάντησε στο θέμα του tragikos topic στην ενότητα Steam & άλλες κοινότητες

Steam News - Steam Bullet Fest is here! - Steam News STORE.STEAMPOWERED.COM You're going to need ALL the bullets for this fest. -

Ειδήσεις απο την Ελλάδα και όλο τον κόσμο v2.0

acct απάντησε στο θέμα του astrolabos topic στην ενότητα Off topic

Judge Learns Lawyers on Both Sides of Case Used AI, Cancels Trial, Kicks Everyone Off the Case WWW.404MEDIA.CO When two AIs argue against each other, the legal system loses.

-

Ειδήσεις

-

Kioxia`s Trending Offers

-

Reviews

.thumb.jpg.8242e1a3b4092eb8a617a807e84532f7.jpg)

.jpg.ae9fbca1db943301ac9a733d0bfaaaf4.jpg)