AMD Instinct MI350P: Ο νέος PCIe AI accelerator με 144GB HBM3E που προκαλεί την Nvidia H200 NVL

Αρχιτεκτονική και τεχνικά χαρακτηριστικά

Το MI350P βασίζεται στην αρχιτεκτονική CDNA 4 της AMD και κατασκευάζεται σε διεργασία TSMC 3nm και 6nm FinFET. Η GPU διαθέτει 8.192 πυρήνες, 128 Compute Units, 512 Matrix Cores και μέγιστο clock στα 2,2GHz. Σε επίπεδο μνήμης, αντιστοιχίζεται με 144GB HBM3E που παρέχουν 4TB/s bandwidth και 128MB last-level cache.

Ουσιαστικά, η AMD πήρε έναν MI350X accelerator και τον έκοψε στα δύο: μισοί υπολογιστικοί πόροι, μισή μνήμη, και λίγο πάνω από τη μισή κατανάλωση ισχύος. Ο MI350X, για σύγκριση, φέρει 288GB HBM3E σε bus interface 8192-bit.

Η κάρτα έχει μήκος 10,5 ιντσών, dual-slot design και fanless (passive) ψύξη, σχεδιασμένη για λειτουργία με TBP 600W. Μπορεί επίσης να ρυθμιστεί σε χαμηλότερο target ισχύος 450W για συμβατότητα με chassis με περιορισμούς ψύξης ή ισχύος. Για την τροφοδοσία, η AMD χρησιμοποιεί 16-Pin connector.

Απόδοση: Θεωρητικά νούμερα vs Nvidia H200 NVL

Η AMD ισχυρίζεται ότι η GPU αποτελεί την ταχύτερη enterprise PCIe κάρτα στην αγορά, με εκτιμώμενα 2.299 TFLOPs και 4.600 peak TFLOPs χρησιμοποιώντας MXFP4.

Η εισαγωγή του MI350P δίνει τελικά στην AMD έναν ισάξιο ανταγωνιστή για το ταχύτερο PCIe AI accelerator της Nvidia, το H200 NVL. Σύμφωνα με τους ισχυρισμούς της AMD, το MI350P υπερτερεί στο FP64 κατά 20%, στο FP16 κατά 43% και στο FP8 κατά 39% σε θεωρητικό compute.

Ωστόσο, η Nvidia H200 NVL ξεπερνά την AMD σε memory bandwidth. Με έξι HBM3e stacks έναντι τεσσάρων του MI350P, η κάρτα της Nvidia — σχεδόν δύο ετών — εξακολουθεί να έχει μνήμη ~20% ταχύτερη. Η H200 NVL υποστηρίζει επίσης υψηλής ταχύτητας chip-to-chip επικοινωνία μέσω NVLink, κάτι που το MI350P δεν προσφέρει.

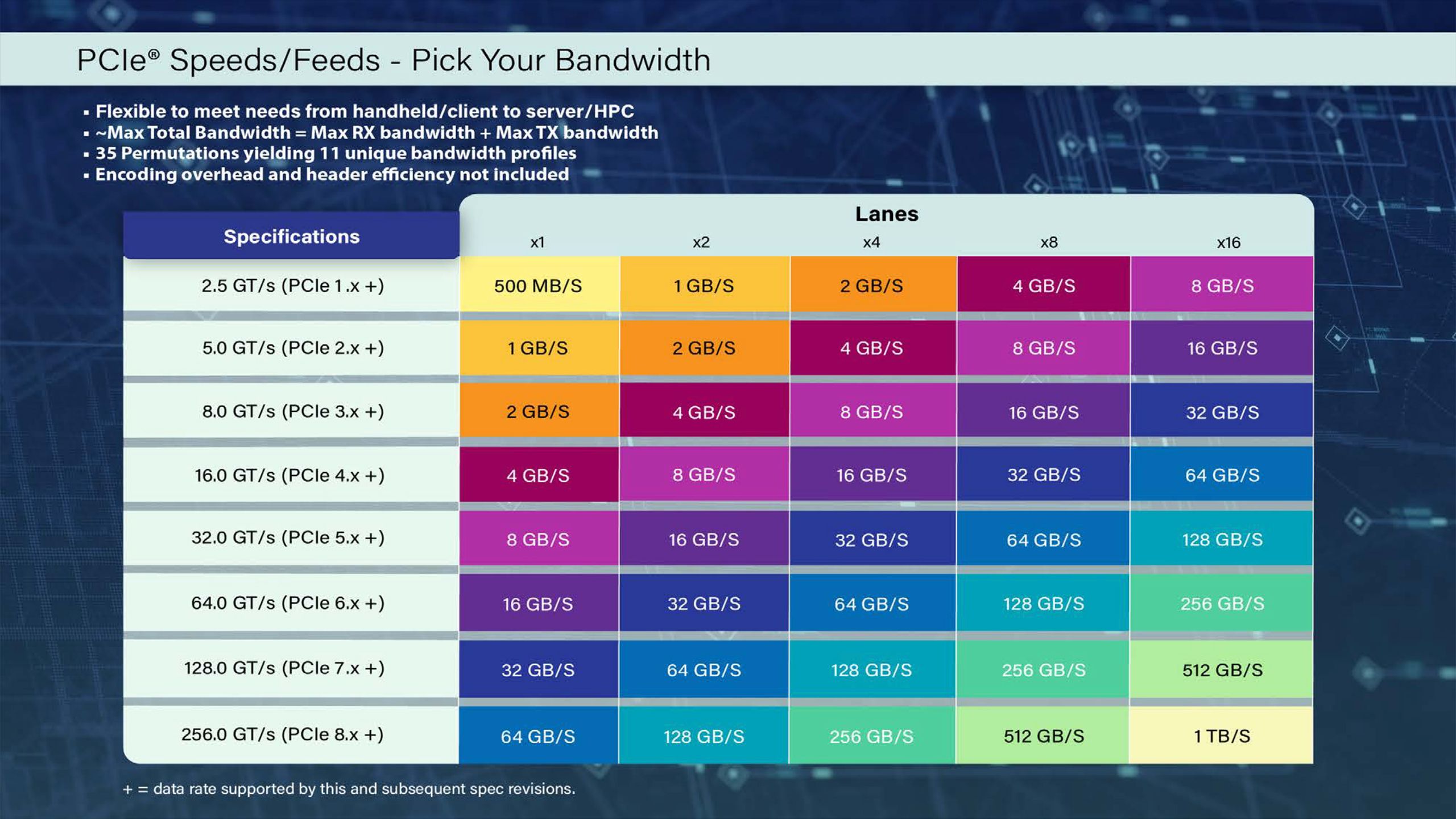

Αξιοσημείωτο είναι ότι η AMD δεν εκθέτει τα GPU-to-GPU Infinity Fabric links στο MI350P. Αποτέλεσμα: τα multi-card setups περιορίζονται στο PCIe bus (Gen5 x16) για επικοινωνία μεταξύ καρτών. Αυτό αποτελεί ίσως τον σημαντικότερο συμβιβασμό του MI350P έναντι του MI350X, καθώς περιορίζει τη χρήση AI μοντέλων μεγαλύτερων από τη μνήμη μιας κάρτας.

Στόχος: On-premises AI χωρίς νέα υποδομή

Οι MI350P PCIe κάρτες είναι dual-slot drop-in κάρτες για standard air-cooled servers, σχεδιασμένες για deployment AI inference on-premises εντός της υφιστάμενης υποδομής ισχύος, ψύξης και rack του data center.

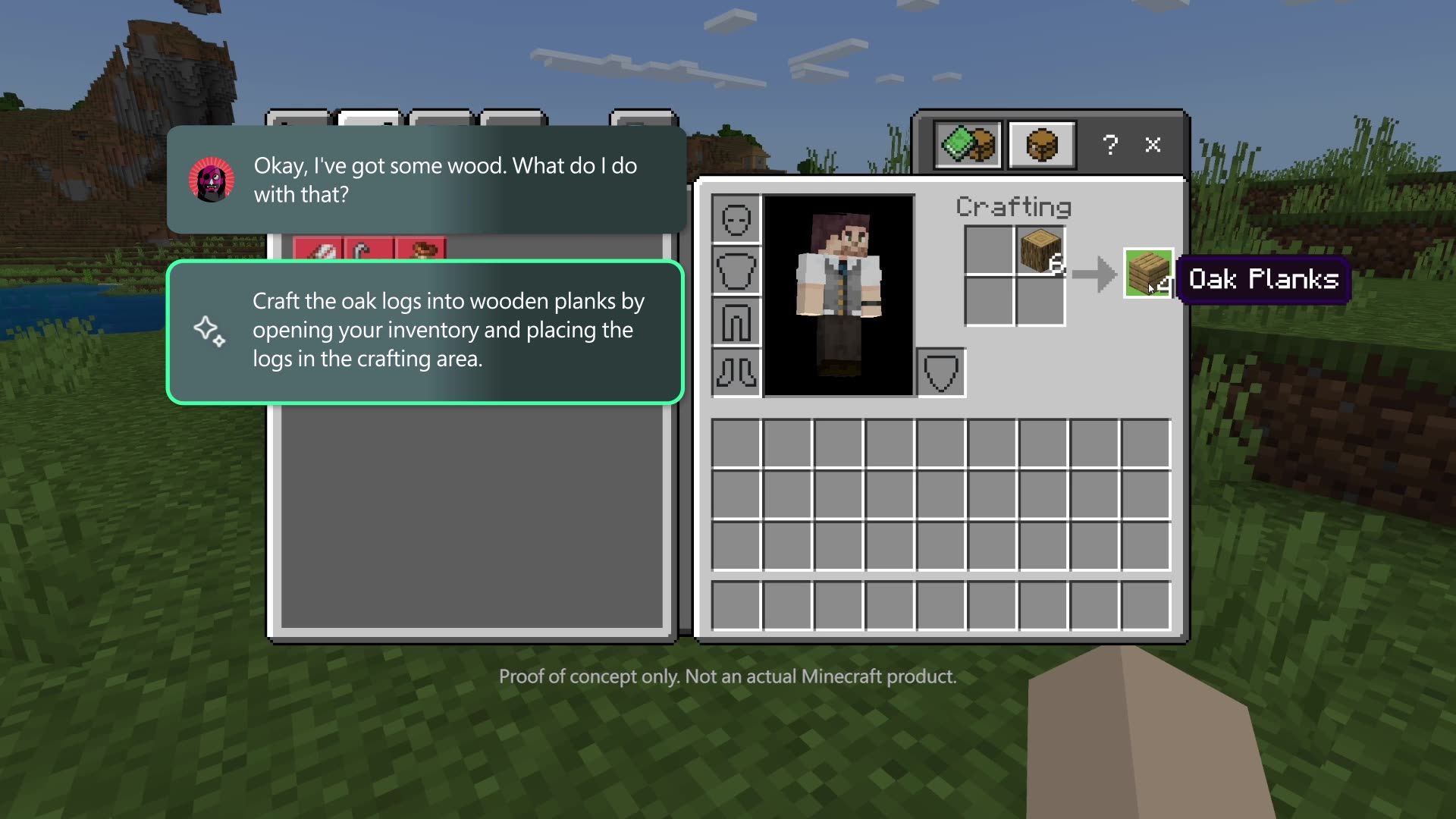

Έως οκτώ MI350P κάρτες μπορούν να συνδυαστούν σε ένα μόνο σύστημα, επιτρέποντας στα data centers να κλιμακώνουν την απόδοση ανάλογα με τις ανάγκες. Η MI350P απευθύνεται σε μικρά, μεσαία και μεγάλα AI workloads inference και RAG pipelines. Η AMD προωθεί την MI350P ως ικανή να χειριστεί περίπου 200–250 δισεκατομμύρια παραμέτρους LLM ανά GPU.

Ένα σύστημα με οκτώ MI350P κάρτες συγκεντρώνει 1.152GB HBM3E και 32TB/s aggregate memory bandwidth σε ένα air-cooled chassis — αρκετά για να φιλοξενήσει ένα μοντέλο τρισεκατομμυρίου παραμέτρων σε MXFP4 σε ένα μόνο σύστημα.

Τιμή, διαθεσιμότητα και ecosystem

Η AMD ανακοίνωσε ότι οι Instinct MI350P PCIe GPUs είναι πλέον διαθέσιμες μέσω variety of partners. Δεν έχει ανακοινωθεί τιμή λίστας.

Η Nvidia δεν έχει ανακοινώσει PCIe έκδοση των B200 Blackwell GPU με HBM μνήμη, οπότε προς το παρόν η AMD διαθέτει τον πιο προηγμένο AI accelerator σε PCIe form factor. Παραμένει ανοικτό το ζήτημα πόσο ευρεία θα είναι η υιοθέτηση της νέας κάρτας, λόγω της κυριαρχίας της Nvidia με το CUDA ecosystem. Η AMD, ωστόσο, εργάζεται για τη βελτίωση του ROCm software stack.

Η AMD παρέχει στους partners της το open-source enterprise AI reference stack χωρίς κόστος άδειας χρήσης, προσφέροντας μεγαλύτερη διαφάνεια κώδικα και μειωμένα λειτουργικά έξοδα — με στόχο επιχειρήσεις που θέλουν να λειτουργήσουν on-premises χωρίς ongoing per-token χρεώσεις.

Πηγές

Tom's Hardware — AMD announces MI350P PCIe AI accelerator card WCCFtech — AMD Launches MI350P, Its First PCIe Instinct In Four Years The Register — AMD takes aim at enterprise AI with PCIe-based Instinct GPUs ServeTheHome — AMD Intros Instinct MI350P Accelerator AMD Official Blog — AMD Instinct MI350P PCIe GPUs

523

.thumb.jpg.9a921205b9aa72bdfad8ea52635b9d2c.jpg)